轻松拿捏高等数学,LLM平均得分90+!GPT-4o、Mistral几乎没错

轻松拿捏高等数学,LLM平均得分90+!GPT-4o、Mistral几乎没错在32道高等数学测试中,LLM表现出色,平均能得分90.4(按百分制计算)。GPT-4o和Mistral AI更是几乎没错!向量计算、几何分析、积分计算、优化问题等,高等AI模型轻松拿捏。研究发现,再提示(Re-Prompting)对提升准确率至关重要。

在32道高等数学测试中,LLM表现出色,平均能得分90.4(按百分制计算)。GPT-4o和Mistral AI更是几乎没错!向量计算、几何分析、积分计算、优化问题等,高等AI模型轻松拿捏。研究发现,再提示(Re-Prompting)对提升准确率至关重要。

Mistral AI,这家法国公司是 AI 助手 Le Chat 和多个基础模型背后的力量组成,被官方视为法国最有前途的科技初创企业之一,且可以说是能与 OpenAI 竞争的欧洲公司。然而,与其 60 亿美元的估值相比,其全球市场份额仍相对较低。

法国大模型独角兽 Mistral AI 进军 OCR(光学字符识别)领域了。一出手就是号称「世界上最好的 OCR 模型」!新产品 Mistral OCR 是一种光学字符识别 API,它为文档理解树立了新标准。

史上首次,Mistral AI的超级助手Le Chat登顶法国免费APP榜首!开发者们激动表示,谢谢Mistral AI,欧洲终于在AI竞赛中有了一席之地。马克龙也宣布,法国将投资1090亿欧元建设欧洲版「星际之门」。

欧洲OpenAI”Mistral AI有新动作了! Le Chat(法语“猫”)全新升级,官方自称它是“您生活和工作的终极AI助手”。

据外电报道,就在谷歌与美联社签署协议的第二天,Mistral 还宣布与法新社 (AFP) 达成内容协议,以提高Mistral 聊天机器人产品Le Chat的答案的准确性。对于这家总部位于巴黎的人工智能公司来说,这是第一笔此类交易。这表明 Mistral 不想被视为仅仅一家基础模型制造商。

“欧洲版 OpenAI” Mistral 的代码模型 CodeStral,又上新了! 而且与 DeepSeek V2.5 和 Claude 3.5 平起平坐,共同位列 Copilot 竞技场第一名。

你是否想过在自己的设备上运行自己的大型语言模型(LLMs)或视觉语言模型(VLMs)?你可能有过这样的想法,但是一想到要从头开始设置、管理环境、下载正确的模型权重,以及你的设备是否能处理这些模型的不确定性,你可能就犹豫了。

欧洲的OpenAI,把ChatGPT功能都复制了。 Mistral AI大模型平台Le Chat新增Canvas、联网搜索、上传PDF等ChatGPT同款功能,而且全都免!费!

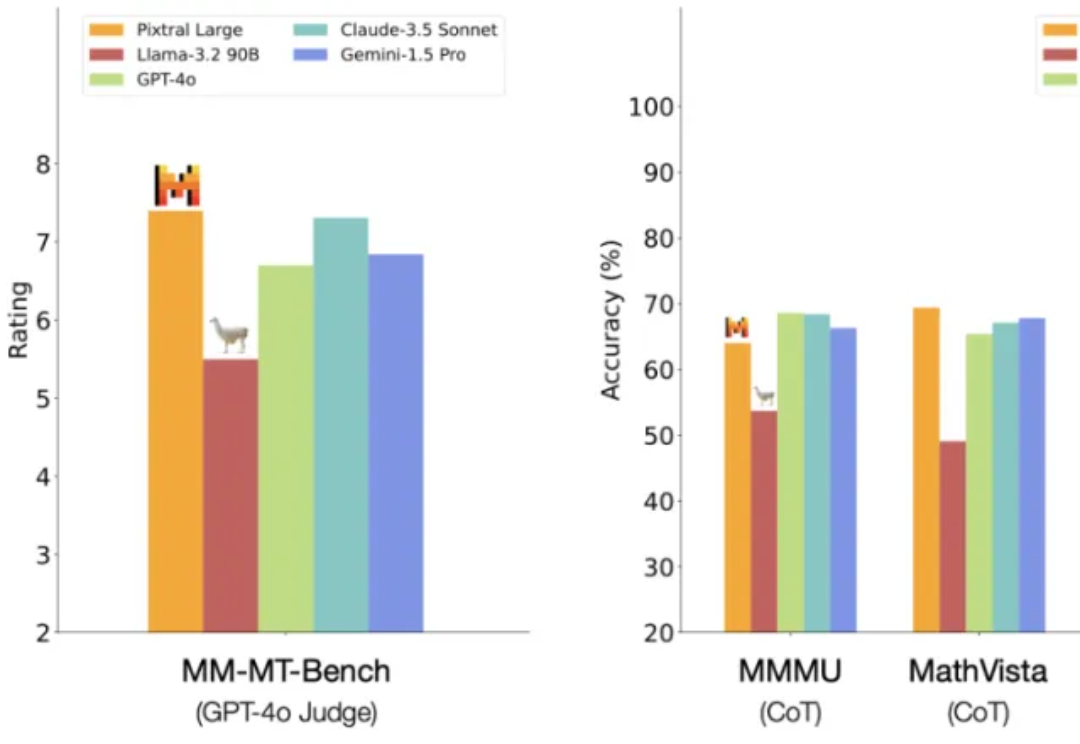

一觉醒来,Mistral AI 又发力了。 就在今天,Mistral AI 多模态家族迎来了第二位成员:一个名为 Pixtral Large 的超大杯基础模型。